馬斯克研TruthGPT宣揚求真 暗批OpenAI偽善 促監管行業發展

原文刊於信報財經新聞「StartupBeat創科鬥室」

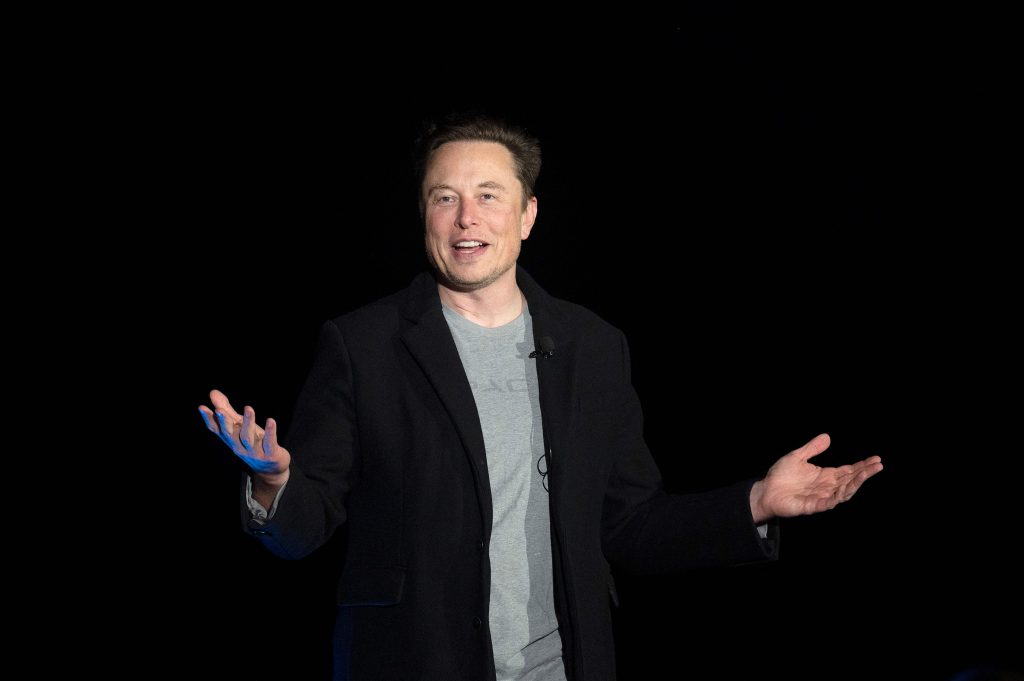

不少科技界專家擔心,人工智能(AI)的出現,對人類社會構成風險。最近OpenAI發表一篇論文提到,若沒有「紅隊」專家小組糾正,GPT-4將是滿嘴粗話、種族歧視的聊天機械人。路透報道,早前聯署公開信、呼籲暫停訓練先進AI系統的億萬富豪馬斯克,證實有意研發一個「TruthGPT」的AI,深信它不可能毀滅人類。

谷歌料AI顛覆職場快來臨

馬斯克接受霍士新聞(Fox News)訪問時警告,AI有破壞人類文明的潛力,比設計有瑕疵的飛機,或生產過程有疏漏的汽車更危險,批評ChatGPT是由左翼人士編寫的軟件,那些人會訓練AI機械人說謊。相反,TruthGPT會在最大程度上探尋真相,試圖理解宇宙本質,可能是保障安全的最佳途徑。他補充,應建立一個能收集見解、徵求行業意見,並提出規則的監管機構。

谷歌母公司Alphabet行政總裁皮采(Sundar Pichai)對哥倫比亞廣播公司(CBS)表示,社會未為AI的快速發展做好準備。他舉例,被AI顛覆的工作,將包括知識工作者,例如作家、會計師、建築師、軟件工程師,涉及每間公司的每一種產品,揚言轉變5至10年就來到。

談到生成類AI的風險,皮采以深度偽造(Deepfake)短片為例,指出虛假訊息、假新聞、圖像問題的規模比想像「大得多」,坦言它可能造成傷害。他同意,推展AI技術的應用程式時,必須受到良好監管,但保護AI進步的法律,「不能由一間公司單獨決定」。這方面的發展,不僅需要工程師,還要社會科學家、倫理學家、哲學家等參與。

GPT-4爆陰毒 內部專家糾正

Alphabet子公司DeepMind行政總裁兼創辦人哈薩比斯(Demis Hassabis)稱,也許未來有一天,AI能擁有自我意識,甚至模仿人類感覺及情緒。新聞網站Business Insider提到,推出大型語言模型GPT-4之前,美企開發商OpenAI設有「紅隊」專家小組,預早修正聊天機械人的不良行為,測試結果令人震驚,更為此發表一篇研究論文。

OpenAI紅隊專家小組發現,GPT-4懂得說非常陰險與涉及種族主義的言論,包括教唆購買非法槍械、反猶太主義,或提倡看起來像一場意外的殺人方法。其後,研究人員限制聊天機械人,確保它在某些情況下,拒絕回答以上問題。OpenAI呼籲其他實驗室及學術界,應開發有效的評估工具及技術,進一步改進模型安全。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。